Tại sao nói rằng mô hình lớn có thể là ngõ cụt trong phát triển phần mềm?

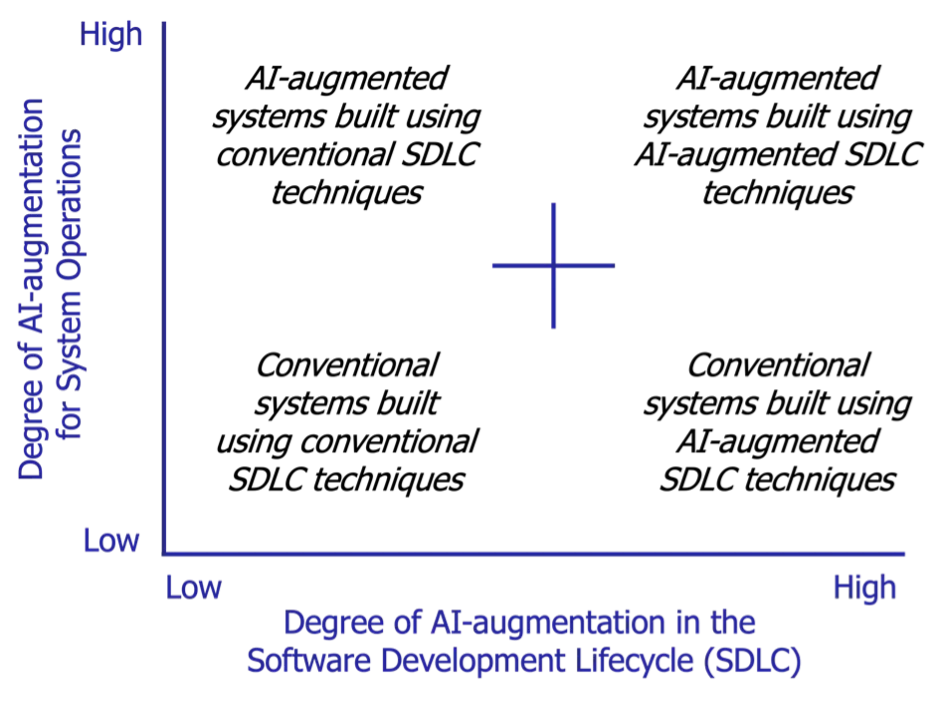

Trong bài viết “Does current AI represent a dead end?” có một số quan điểm đặc biệt liên quan đến các nhà phát triển phần mềm. Bài viết này chỉ tập trung vào việc sử dụng các mô hình ngôn ngữ lớn (LLM) như một phần của giải pháp sản phẩm, chứ không phải là cách sử dụng các công cụ AI trong quá trình phát triển (ví dụ, Cursor và Zed AI).

Một trong những thách thức hiện tại đối với LLM là chúng được bán giống như một chiếc xe hơi – người dùng cần trả phí cho toàn bộ sản phẩm mà không thể mong đợi sử dụng chúng như các module có thể kết hợp. Điều này gây ra vấn đề vì LLM không thể dễ dàng được phân tách hoặc tùy chỉnh, điều này làm giảm khả năng kiểm soát và bảo mật.

Từ góc độ học thuật, sự thiếu hụt tính chất có thể phân tách cũng đồng nghĩa với việc thiếu tính minh bạch. Chúng ta không thể tách rời hành vi của LLM khỏi dữ liệu huấn luyện của chúng. Điều này tạo ra rủi ro về an ninh và quyền riêng tư, vì chúng ta không có cách đáng tin cậy để ngăn chặn việc rò rỉ thông tin nhạy cảm.

Bên cạnh đó, vấn đề về quyền sở hữu pháp lý vẫn còn phức tạp. Chúng ta không thể chứng minh rằng kết quả của LLM không vi phạm quyền sở hữu trí tuệ hiện có, do chúng mang theo “gánh nặng” của dữ liệu huấn luyện.

Cuối cùng, các nhà phát triển phần mềm nên hướng tới việc xây dựng các hệ thống AI có thể giải thích, kiểm thử và quản lý một cách minh bạch. Điều này đòi hỏi quy trình huấn luyện phải minh bạch, có thể báo cáo, lặp lại và đảo ngược.

Tóm lại, năm từ khóa chính:

1. Mô hình Ngôn ngữ Lớn (LLM)

2. Phát triển Phần mềm

3. Tính Minh bạch

4. An toàn và Quyền Riêng tư

5. Quyền Sở hữu Trí tuệ

© Thông báo bản quyền

Bản quyền bài viết thuộc về tác giả, vui lòng không sao chép khi chưa được phép.

Những bài viết liên quan:

Không có đánh giá...