Các mô hình tạo hình ảnh như Flux và SD bị “cấm”, nhưng lần này các công ty lớn ở Silicon Valley không phản đối!

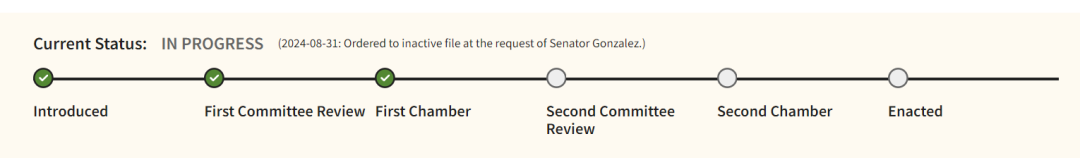

Trong khi mọi người đang lo lắng về Dự luật SB 1047, một dự luật khác của California, Dự luật AB 3211, đã được đệ trình lên cơ quan lập pháp và có vẻ như sắp được thông qua.

Dự luật AB 3211 này sẽ có tác động lớn hơn vì nó cấm bất kỳ hệ thống tạo hình ảnh AI nào chưa triển khai cơ chế dấu vết nước mạnh mẽ từ hoạt động. Điều này gần như khiến việc vận hành các hệ thống như vậy trong phạm vi California trở nên không thể. Dự luật yêu cầu rằng các dấu vết nước này phải chứa dữ liệu metadata cụ thể, không thể nhìn thấy bằng mắt thường và khó xóa bỏ, để xác định hình ảnh là sản phẩm của AI đồng thời cung cấp thông tin về cách thức, thời gian và nguồn gốc tạo ra hình ảnh. Metadata là thông tin cấu trúc hoặc mô tả về dữ liệu.

Theo Yenta Magenta, một nhà phân tích, yêu cầu này về mặt kỹ thuật là không khả thi. Việc chèn hoặc đính kèm metadata không thể xóa vào tệp hình ảnh (hoặc bất kỳ tệp số nào khác) khi tạo ra chúng gần như không thể – điều này đã được minh chứng bởi các giải pháp DRM thất bại trước đó. Magenta cũng cho biết, yêu cầu này có thể dễ dàng bị phá vỡ bằng cách chụp màn hình lại hình ảnh, và thậm chí nếu các nhà phát triển tạo ra dấu vết nước thực sự không thể phá vỡ, thì yêu cầu này cũng vượt quá khả năng của hầu hết các nhà xây dựng mô hình, đặc biệt là cộng đồng mã nguồn mở. Dự luật còn yêu cầu tất cả các nhà xây dựng mô hình công bố các công cụ kiểm tra chống đối kháng và công bố các công cụ để phát hiện nội dung do mô hình hoặc hệ thống của họ tạo ra. Mặc dù một số điều khoản khác của dự luật sẽ được hoãn thi hành đến năm 2026, nhưng hầu hết các điều khoản chính sẽ có hiệu lực ngay sau khi dự luật được thông qua.

Nếu dự luật này được thực thi theo cách mà nó hiện đang được viết, hầu hết các mô hình Stable Diffusion hiện tại, bao gồm cả việc tinh chỉnh và LoRA, sẽ bị coi là bất hợp pháp tại California. Các trang web như CivitAI và Hugging Face sẽ phải lọc nội dung được tạo ra bởi cư dân California, thậm chí có thể chặn hoàn toàn truy cập của họ (do chi phí sàng lọc quá cao, việc chặn hoàn toàn có thể trở thành phương án phổ biến).

Một số người, như Jacob Miller, cựu kỹ sư của Microsoft, cho rằng Dự luật AB 3211 nhằm yêu cầu các hình ảnh có metadata để phân biệt giữa hình ảnh AI và hình ảnh “thật”, và yêu cầu nền tảng công bố tính chân thực của hình ảnh. Miller cho rằng không thể tạo ra một phương pháp chắc chắn để theo dõi điều này. Ông nói rằng cuối cùng, dự luật này có thể tạo ra nhiều vấn đề hơn là giải quyết. Ông cho rằng việc tạo ra hình ảnh có metadata được coi là “thật” sẽ làm cho việc nền tảng tuyên bố rằng “đây là một hình ảnh thật” trở nên tồi tệ hơn so với việc không có bất kỳ tuyên bố miễn trừ nào.

Microsoft, OpenAI và Adobe đều ủng hộ biện pháp này. Magenta giải thích rằng họ có thể nhận ra rằng không có mô hình hoặc dịch vụ tạo hình ảnh AI mã nguồn mở nào có thể đáp ứng yêu cầu kỹ thuật. Do đó, dự luật này có thể trở thành vũ khí hữu hiệu để họ đánh bại các đối thủ cạnh tranh mã nguồn mở. Điều này có thể dẫn đến việc kết thúc mọi mô hình AI mã nguồn mở tại California và ngăn chặn các công ty muốn kinh doanh trong lĩnh vực này.

Dự luật này cũng cấm bán bất kỳ máy ảnh tĩnh hoặc video mới nào không sử dụng hệ thống xác thực hình ảnh. Tuy nhiên, tình hình vẫn còn chút hy vọng vì quy định này chỉ áp dụng cho thiết bị mới và sẽ không có hiệu lực trong vài năm nữa. Định nghĩa về “thiết bị mới” vẫn còn mơ hồ, điều này có thể khiến việc mua các thiết bị cũ để tiết kiệm chi phí trở nên bất hợp pháp.

Dự luật này cũng đặt ra các yêu cầu nghiêm ngặt cho các nền tảng truyền thông xã hội lớn ở California, bao gồm việc kiểm tra metadata để xác định hình ảnh nào là sản phẩm của AI và yêu cầu nền tảng công bố điều này. Hình ảnh không thể xác định là không phải sản phẩm của AI sẽ được đánh dấu là nguồn không rõ ràng.

Đối với Dự luật SB 1047, dự luật này yêu cầu các doanh nghiệp AI hoạt động tại California phải thực hiện hàng loạt biện pháp phòng ngừa trước khi huấn luyện các mô hình cơ bản phức tạp. Điều này bao gồm khả năng tắt hoàn toàn mô hình, đảm bảo mô hình không bị can thiệp không an toàn sau khi huấn luyện và triển khai các chương trình thử nghiệm để đánh giá mô hình hoặc phiên bản phái sinh của chúng có dễ gây ra hoặc được sử dụng để thực hiện những tổn hại nghiêm trọng hay không.

SB 1047 áp dụng cho các mô hình AI lớn trên thế giới: chi phí ít nhất 100 triệu đô la và sử dụng 10^26 FLOPS trong quá trình huấn luyện; hoặc tạo ra mô hình AI bằng cách tinh chỉnh ít nhất 10^25 phép tính nguyên hoặc phép tính dấu phẩy động ba lần.

Với các mô hình mã nguồn mở và sản phẩm phái sinh, dự luật quy định rằng nhà phát triển ban đầu phải chịu trách nhiệm, trừ khi một nhà phát triển khác chi 10 triệu đô la để tạo ra sản phẩm phái sinh của mô hình ban đầu.

Tỉnh bang California sẽ thành lập một cơ quan mới, Hội đồng Mô hình Tiên tiến, để giám sát, với 9 thành viên, bao gồm đại diện từ ngành AI, cộng đồng mã nguồn mở và học viện, được bổ nhiệm bởi thống đốc và cơ quan lập pháp.

Người soạn thảo chính của dự luật, thượng nghị sĩ Scott Wiener, cho biết SB 1047 là một dự luật rất hợp lý, chỉ yêu cầu các phòng thí nghiệm AI lớn làm những gì họ đã cam kết: thử nghiệm mô hình của mình xem có rủi ro an ninh thảm khốc không. Chúng tôi đã làm việc cùng với các nhà vận động cho mã nguồn mở, công ty Anthropic và các tổ chức khác trong suốt một năm để hoàn thiện và cải thiện dự luật này.

Geoffrey Hinton và Yoshua Bengio, được gọi là “cha đẻ của trí tuệ nhân tạo”, đều ủng hộ dự luật này, nhưng vẫn có nhiều người phản đối, bao gồm Li Fei-Fei, người cho rằng dự luật này sẽ “làm tổn hại hệ sinh thái AI non trẻ của chúng ta”; Andrew Ng, người cho rằng dự luật này là “một cuộc tấn công vào mã nguồn mở” và mô hình mã nguồn mở có thể tạo ra rủi ro thêm cho người tạo ra chúng, vì chúng dễ bị sửa đổi và triển khai với mục đích độc hại; Yang Likun, người cho rằng SB 1047 sẽ làm hại công việc nghiên cứu và dựa trên “ảo tưởng về rủi ro tồn tại do một số nhóm tư duy nhỏ lẻ”.

Càng ngày càng có nhiều người từ Silicon Valley phản đối Dự luật SB 1047, bao gồm OpenAI, Anthropic, các chính trị gia Zoe Lofgren và Nancy Pelosi, và Phòng Thương mại California. Đầu tháng 8, OpenAI đã gửi một bức thư công khai phản đối Dự luật SB 1047. Tổ chức thương mại đại diện cho Google, Apple, Amazon và các công ty công nghệ lớn khác, Phòng Tiến bộ, cũng đã gửi một bức thư công khai phản đối dự luật này, cho rằng SB 1047 hạn chế tự do và “đẩy công nghệ và đổi mới ra khỏi California”.

Ngược lại, Dự luật AB 3211 đã được thông qua với tỷ lệ 62:0 trong Quốc hội California (trong tổng số 80 nghị sĩ). Dự luật này có thể sẽ được thông qua trong Thượng viện California, nhưng liệu Thống đốc Gavin Newsom có ký ban hành dự luật này hay không vẫn chưa rõ. Dự luật này cũng gặp phải sự phản đối từ Electronic Frontier Foundation (EFF) và American Civil Liberties Union (ACLU), mặc dù họ chưa đưa ra ý kiến cụ thể.

Trên đây là những diễn biến liên quan đến Dự luật AB 3211 và SB 1047, hai dự luật đang gây tranh cãi tại California về quản lý và điều chỉnh AI. Dự luật này không chỉ ảnh hưởng đến ngành công nghiệp AI mà còn có thể tác động lớn đến quyền tự do ngôn luận và quyền riêng tư của cư dân California.

Từ khóa:

- AI

- Luật pháp

- Mã nguồn mở

- Trí tuệ nhân tạo

- California

© Thông báo bản quyền

Bản quyền bài viết thuộc về tác giả, vui lòng không sao chép khi chưa được phép.

Những bài viết liên quan:

Không có đánh giá...