Ứng dụng Zhizhu Qingyan được nâng cấp tính năng gọi video mới, ra mắt mô hình nền tảng thế hệ mới.

Chức năng Video Cuộc gọi của ứng dụng Qingyan và Mô hình Mới GLM-4-Plus

Ứng dụng Qingyan ra mắt Chức năng Video Cuộc gọi và Mô hình Mới GLM-4-Plus

Những ngày gần đây, Zhipu đã công bố việc ra mắt chức năng Video Cuộc gọi trên ứng dụng Qingyan. Đồng thời, họ cũng đã giới thiệu mô hình lớn thế hệ mới GLM-4-Plus, cùng với việc mở nguồn CogVideoX-5B và GLM-4-Flash miễn phí.

Chức năng Video Cuộc gọi trên ứng dụng Qingyan đánh dấu một bước tiến quan trọng, sau khi ra mắt chức năng tạo video Qingyan vào tháng 7. Đây là ứng dụng đầu tiên dành cho người dùng cuối (C-end) cung cấp dịch vụ cuộc gọi video.

Chức năng này vượt qua các mô hình văn bản và âm thanh, đồng thời có khả năng suy luận thời gian thực. Khi bạn gọi video đến Qingyan, bạn có thể trò chuyện một cách trôi chảy với nó, ngay cả khi bạn liên tục xen kẽ. Qingyan có khả năng hiểu nội dung từ camera, lắng nghe lệnh và thực hiện chính xác.

Dưới đây là một số ví dụ về cách Qingyan hoạt động trong các tình huống như đồng hành trong trò chơi, hướng dẫn bài tập, và trong một số tình huống cuộc sống:

Được biết, chức năng Video Cuộc gọi trên ứng dụng Qingyan sẽ được ra mắt vào ngày 30 tháng 8, và sẽ được mở rộng cho một số lượng người dùng ban đầu. Đồng thời, họ cũng đang mở cổng đăng ký bên ngoài.

Liên kết thử nghiệm Video Cuộc gọi của Qingyan: https://zhipu-ai.feishu.cn/share/base/form/shrcnqpIx9q5ILEFeT2cPNhyuSf

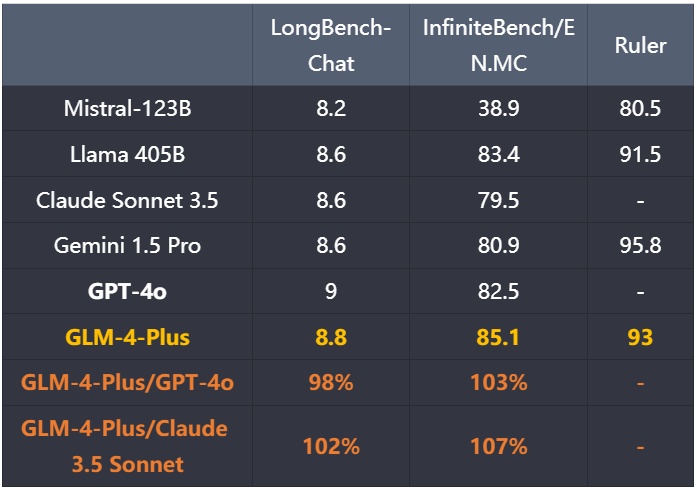

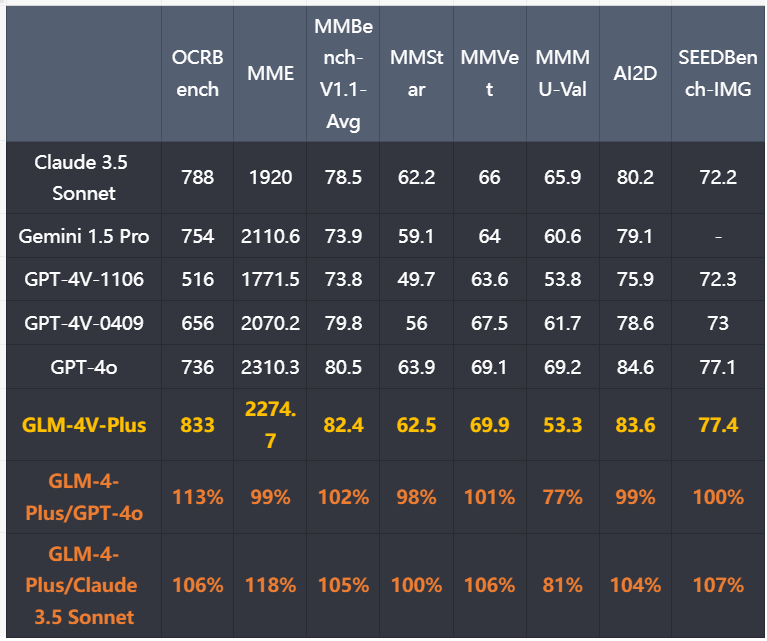

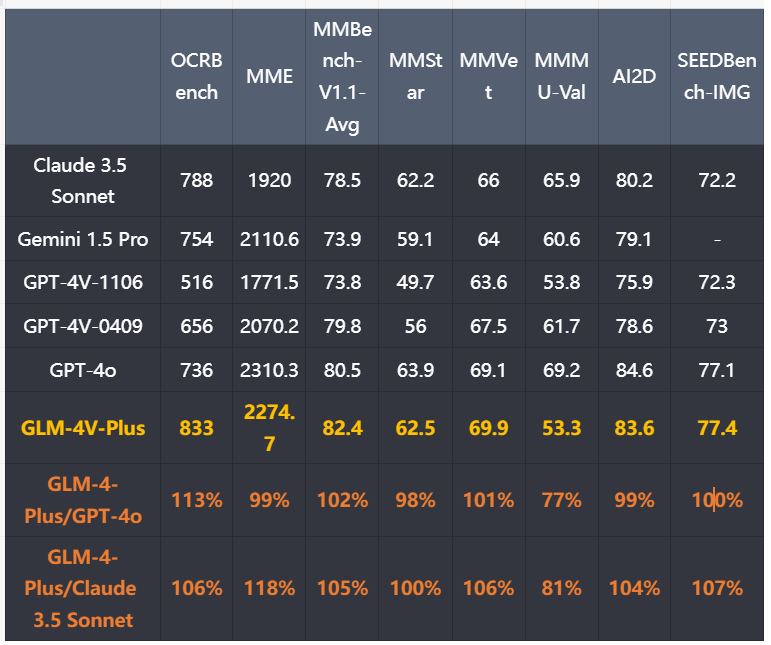

GLM-4-Plus là phiên bản mới nhất của mô hình lớn GLM tự phát triển hoàn toàn bởi Zhipu, với sự cải thiện đáng kể về hiểu ngôn ngữ, tuân theo chỉ dẫn và xử lý văn bản dài.

GLM-4-Plus sử dụng một lượng lớn dữ liệu tổng hợp chất lượng cao để nâng cao hiệu suất mô hình, và sử dụng PPO để cải thiện hiệu suất suy luận (như toán học, thuật toán mã hóa), phản ánh tốt hơn sự ưa thích của con người.

Từ góc độ ngôn ngữ, GLM-4-Plus tương đương với GPT4 và Llama3.1 với 405 tỷ tham số.

GLM-4-Plus cũng có khả năng xử lý văn bản dài thông qua chiến lược dữ liệu ngắn và dài chính xác hơn, đạt được hiệu suất suy luận mạnh mẽ hơn so với các mô hình quốc tế tiên tiến.

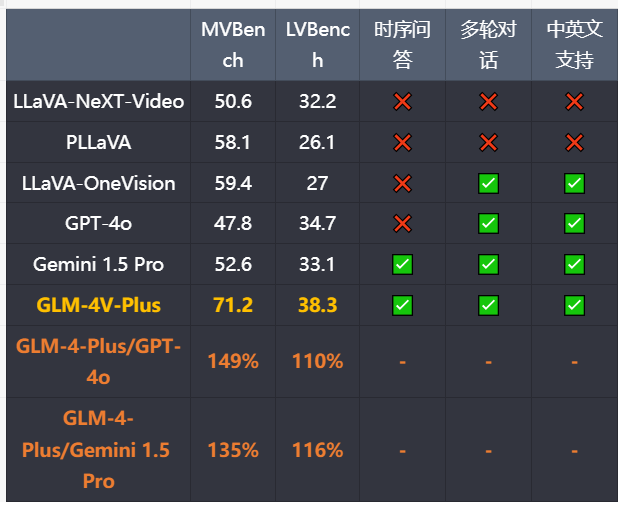

GLM-4-Plus còn có khả năng hiểu và phân tích nội dung video phức tạp, đồng thời có khả năng nhận thức thời gian.

Hiện tại, GLM-4-Plus đã được triển khai trên nền tảng mô hình lớn của Zhipu, và doanh nghiệp và nhà phát triển có thể bắt đầu sử dụng API của Zhipu để gọi mô hình lớn mới nhất.

Thư viện tài liệu API cập nhật cho GLM-4-Plus: https://bigmodel.cn/dev/api#glm-4

Thư viện tài liệu API cập nhật cho GLM-4V-Plus: https://bigmodel.cn/dev/api#glm-4v

Trang giới thiệu mô hình MaaS (Model as a Service) (bao gồm bản tóm tắt của mô hình mới nhất): https://bigmodel.cn/dev/howuse/model

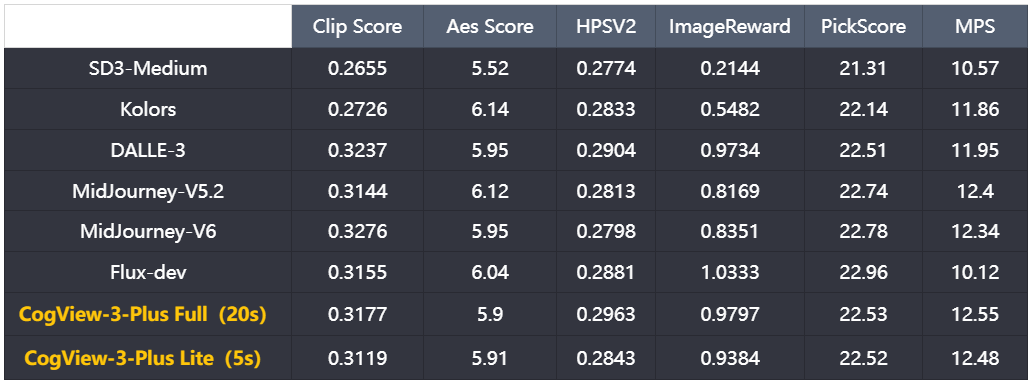

Mô hình sinh hình ảnh mới nhất, CogView-3-Plus, có hiệu quả tương đương với các mô hình hàng đầu như MJ-V6 và FLUX, và hỗ trợ chức năng chỉnh sửa hình ảnh.

Cập nhật mới nhất cho CogView-3-Plus: https://bigmodel.cn/dev/api#cogview

Bên cạnh việc mở nguồn phiên bản 2B của CogVideoX, phiên bản 5B cũng đã được mở nguồn gần đây, với hiệu suất mạnh mẽ hơn và yêu cầu bộ nhớ GPU tối thiểu chỉ 11.4GB. Đồng thời, CogVideoX-2B đã chuyển sang giấy phép Apache 2.0, cho phép bất kỳ doanh nghiệp hay cá nhân nào sử dụng tự do.

Với việc mở nguồn CogVideoX-5B, Zhipu không chỉ dẫn đầu về số lượng mô hình mở nguồn mà còn đạt được tổng tải về vượt quá 20 triệu lần, đóng góp vào cộng đồng mã nguồn mở quốc tế.

Với sự tiến bộ về kỹ thuật, hiệu suất và tối ưu hóa chi phí, Zhipu đã công bố rằng mô hình lớn GLM-4-Flash trên nền tảng mô hình lớn bigmodel.cn, được coi là mô hình hiệu quả nhất, hiện đã hoàn toàn miễn phí. Người dùng có thể nhanh chóng và miễn phí xây dựng mô hình và ứng dụng riêng của mình thông qua API của GLM-4-Flash. Đây cũng là API miễn phí đầu tiên của nền tảng Zhipu.

Zhipu cho biết, mô hình cơ sở mới nhất này, cùng với các mô hình khác như CogVideoX, đã hoàn thiện hệ thống mô hình lớn toàn diện do họ tự phát triển, thúc đẩy Zhipu hướng tới việc đối sánh với các tiêu chuẩn hàng đầu thế giới.

Từ ngày 18-19 tháng 8 năm 2024, Hội nghị AI toàn cầu AICon tại Thượng Hải đã diễn ra thành công tốt đẹp, thu hút hơn 60 chuyên gia hàng đầu trong lĩnh vực mô hình lớn, thảo luận về các chủ đề nóng như cơ chế huấn luyện và suy luận mô hình lớn, tích hợp đa mô hình, tiến bộ tiền tuyến của Trí tuệ nhân tạo (AI), chiến lược tạo ra RAG (Retrieval-Augmented Generation), và tối ưu hóa và ứng dụng mô hình bên cạnh thiết bị. Sau sự cho phép của các diễn giả, «AI Frontline» đã tổng hợp một bộ sưu tập slide trình bày độc quyền, không thể bỏ lỡ. Hãy theo dõi «AI Frontline» và trả lời từ khóa «PPT» để nhận miễn phí.

InfoQ sẽ tổ chức Hội nghị Phát triển Phần mềm Toàn cầu QCon tại Thượng Hải vào ngày 18-19 tháng 10, bao gồm các kỹ sư trước và sau, kỹ sư thuật toán, quản lý kỹ thuật, người sáng lập, và nhà đầu tư. Nội dung bao gồm các chủ đề nóng hiện nay (AI Agent, AI Infra, RAG, v.v.) và những truyền thống kinh điển (kiến trúc, ổn định, cloud native, v.v.), tập trung vào tính thực hành và khả năng tham khảo. Hiện tại, hội nghị đã bắt đầu đăng ký và bạn có thể nhận được ưu đãi 20% giảm giá, tiết kiệm 960 nhân dân tệ (giá gốc 4800 nhân dân tệ). Chi tiết có thể liên hệ với quản lý vé 17310043226.

Từ khóa

- Qingyan

- GLM-4-Plus

- Video Cuộc gọi

- Mô hình lớn

- Open Source

© Thông báo bản quyền

Bản quyền bài viết thuộc về tác giả, vui lòng không sao chép khi chưa được phép.

Những bài viết liên quan:

Không có đánh giá...