Feng Jinghui của Baidu: Từ làm sạch dữ liệu đến xây dựng hàng rào an toàn, phân tích sâu về xây dựng an toàn gốc của mô hình lớn.

Bảo mật nội dung trong mô hình lớn

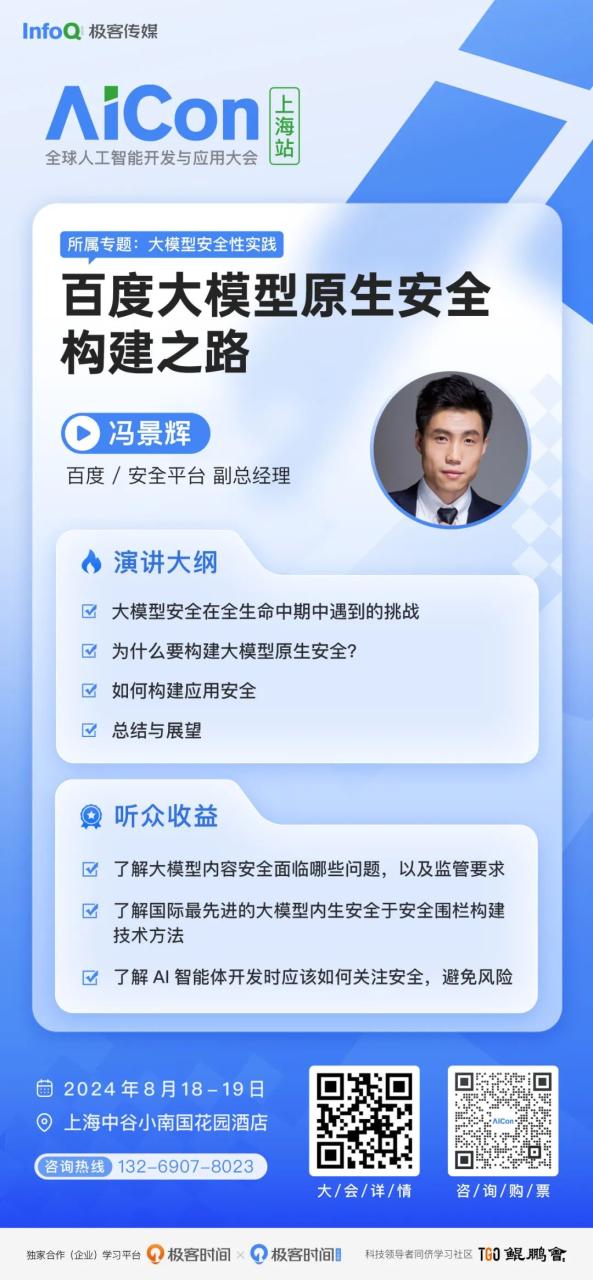

Với sự phát triển của các mô hình lớn, vấn đề bảo mật nội dung đã trở nên quan trọng hơn bao giờ hết. InfoQ đã mời ông Feng Jinghui, Phó Tổng Giám đốc của Baidu Security, tham gia diễn đàn AICon tại Thượng Hải vào ngày 18-19 tháng 8 để chia sẻ về chủ đề “Đường lối xây dựng bảo mật nguyên bản của mô hình lớn Baidu”. Dưới đây là cuộc phỏng vấn trước với ông Feng.

Trong cuộc phỏng vấn, ông Feng cho biết, tính năng thông minh, không xác định và không giải thích được của mô hình lớn đã tạo ra những thách thức lớn đối với việc bảo mật nội dung. Điều này buộc các nhà phát triển phải xem xét vấn đề an toàn ngay từ giai đoạn thiết kế mô hình. Baidu đã thực hiện nhiều sáng kiến đổi mới trong lĩnh vực này, bao gồm làm sạch dữ liệu, đồng bộ hóa an toàn, công nghệ an toàn nội sinh và hàng rào an toàn, tạo thành một giải pháp an toàn toàn diện.

Nổi bật nhất là Baidu đã sử dụng phương pháp bốn bước để làm sạch dữ liệu và áp dụng mô hình trả lời đại diện để nâng cao mức độ tự động hóa và trí tuệ trong việc kiểm duyệt nội dung. Ông Feng nhấn mạnh tầm quan trọng của việc xây dựng bảo mật nguyên bản, chỉ ra rằng qua việc điều chỉnh giám sát có hướng dẫn và học máy tăng cường từ phản hồi của con người, chất lượng và độ tin cậy của mô hình có thể được cải thiện đáng kể.

Ông Feng cũng đề cập đến việc bảo mật nội dung trong quá trình đào tạo, làm sạch dữ liệu là rất quan trọng. Chỉ có dữ liệu sạch sẽ mới có thể đào tạo ra mô hình tốt hơn. Giải pháp bảo mật nội dung của Baidu cũng cung cấp một loạt các phương pháp làm sạch và đánh giá dữ liệu để đối phó với thách thức về việc làm sạch an toàn.

Trong giai đoạn tinh chỉnh, việc đồng bộ hóa an toàn là rất quan trọng, thông qua SFT và RLHF, thực hiện sự đồng bộ hóa giữa con người và mô hình, có thể ảnh hưởng đáng kể đến mức độ an toàn của đầu ra mô hình.

Trong giai đoạn suy luận và triển khai, việc triển khai an toàn mô hình, bảo vệ quyền sở hữu trí tuệ và dữ liệu không bị đánh cắp là những vấn đề mà mọi người quan tâm. Đối mặt với thách thức này, Baidu đã giới thiệu giải pháp bảo mật dữ liệu mô hình lớn, thông qua việc đào tạo dữ liệu mật và mã hóa luồng tệp mô hình, tạo ra giải pháp toàn diện không cần tin cậy và không cần thay đổi.

Trong giai đoạn hoạt động kinh doanh, tính an toàn của nội dung do mô hình tạo ra là điều mà mọi người quan tâm, vì nó tồn tại một số rủi ro không chắc chắn. Chúng ta nói đến sự không chắc chắn chủ yếu là chỉ rằng, ngay cả khi đầu vào giống nhau, đầu ra cũng có thể khác nhau. Sự không chắc chắn này xuất phát từ các thông số phức tạp bên trong mô hình và đa dạng của dữ liệu huấn luyện. Nguy hiểm hơn, mô hình đôi khi có thể tạo ra thông tin hư cấu hoặc không chính xác, điều này được gọi là “ảo tưởng mô hình” hoặc “ảo tưởng sự thật”. Ví dụ, mô hình có thể tạo ra các sự kiện, nhân vật hoặc dữ liệu không tồn tại, đây là một rủi ro lớn đối với các doanh nghiệp phụ thuộc vào thông tin chính xác.

Ngoài ra, giới hạn an toàn của mô hình có thể bị vượt qua bằng cách xây dựng các cụm từ gợi ý một cách cẩn thận, điều này được gọi là tấn công “trốn thoát”. Những kẻ tấn công tận dụng các lỗ hổng trong cơ chế tạo ra của mô hình, thiết kế đầu vào cụ thể để mô hình tạo ra thông tin gây hại hoặc không phù hợp. Ví dụ, thông qua các cụm từ gợi ý cụ thể, mô hình có thể tạo ra thông tin bí mật nhạy cảm, lời lẽ căm thù, thông tin giả mạo, điều này gây ra mối đe dọa an ninh nghiêm trọng đối với doanh nghiệp và người dùng.

Để giải quyết vấn đề về an toàn nội dung của mô hình, giải pháp an toàn mô hình lớn của Baidu thông qua việc sử dụng công nghệ như can thiệp ngữ nghĩa và phân tích ý định, có thể chống lại các cuộc tấn công tiên tiến hiệu quả, kết hợp với mô hình trả lời đại diện để tối đa hóa việc phòng ngừa rủi ro đầu ra an toàn.

Một số điểm chính về an toàn nội dung trong mô hình lớn:

- Bảo mật nguyên bản thông qua việc làm sạch dữ liệu và đồng bộ hóa an toàn

- Sử dụng mô hình trả lời đại diện để tăng cường kiểm duyệt nội dung

- Tích hợp công nghệ hàng rào an toàn để bảo vệ mô hình khỏi các mối đe dọa bên ngoài

- Xây dựng hệ thống đánh giá và phân loại ý định để quản lý yêu cầu đầu vào một cách hiệu quả

- Phát triển các công cụ thông minh để hiểu và phân tích ngữ cảnh đa vòng đối thoại

Hy vọng rằng qua buổi chia sẻ của mình, ông Feng sẽ giúp mọi người nhận thức được rủi ro an toàn của mô hình lớn, và hiểu rằng bảo mật nội dung của mô hình lớn liên quan mật thiết đến sản xuất hàng ngày của chúng ta. Mong rằng nhiều bạn bè hơn nữa sẽ quan tâm và tham gia vào sự nghiệp bảo mật mô hình lớn, góp phần bảo vệ cuộc cách mạng công nghệ này. Đồng thời, cũng kêu gọi các cơ quan chức năng duy trì thái độ mở và cởi mở đối với công nghệ mới, và sớm chú ý đến rủi ro của đa phương tiện, đưa ra các quy định hướng dẫn ngành phát triển lành mạnh.

**Từ khóa:** Bảo mật nội dung, Mô hình lớn, An toàn, Baidu, Trí tuệ nhân tạo

© Thông báo bản quyền

Bản quyền bài viết thuộc về tác giả, vui lòng không sao chép khi chưa được phép.

Những bài viết liên quan:

Không có đánh giá...