Đảo ngược kiến trúc truyền thống! Nhà khoa học gốc Hoa 20 năm tâm huyết: AI có thể nâng cao hiệu suất 1000 lần, nhu cầu trong tương lai sẽ bùng nổ!

Mô Hình Tính Toán Ngẫu nhiên Trong Bộ Nhớ (CRAM) Giảm 1000 Lần Năng Lượng Cho Trí Tuệ Nhân Tạo

Gần đây, một nhóm các nhà nghiên cứu từ Trường Khoa học và Kỹ thuật của Đại học Minnesota đã giới thiệu một mô hình mới mà trong đó dữ liệu sẽ không bao giờ rời khỏi bộ nhớ, được gọi là Bộ Nhớ Tính Toán Ngẫu nhiên (CRAM). So với các phương pháp hiện tại, mô hình này có thể giảm nhu cầu năng lượng cho các ứng dụng trí tuệ nhân tạo tới 1000 lần hoặc hơn. Trong một thí nghiệm mô phỏng, công nghệ CRAM đã thể hiện hiệu quả tiết kiệm năng lượng lên tới 2500 lần.

Đường dẫn bài báo: https://www.nature.com/articles/s44335-024-00003-3

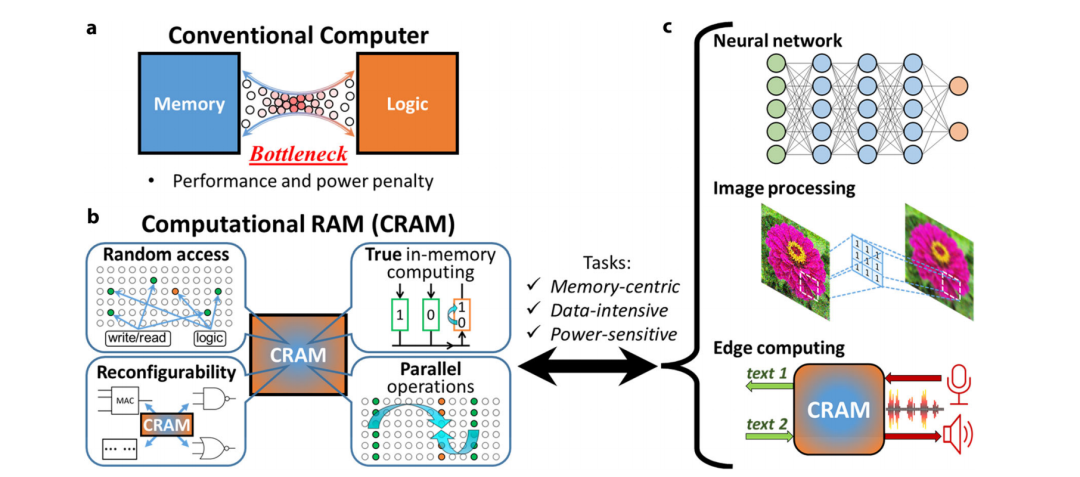

Nói chung, tính toán truyền thống dựa trên kiến trúc Von Neumann, với các đơn vị xử lý và bộ nhớ độc lập, đòi hỏi việc di chuyển dữ liệu liên tục giữa chúng, một quá trình tiêu tốn năng lượng.

CRAM của nhóm Đại học Minnesota đã hoàn toàn lật ngược mô hình này, sử dụng các thiết bị điện tử dựa trên spin (MTJ) để thực hiện tính toán trực tiếp trong bộ nhớ. Thiết bị điện tử dựa trên spin không phụ thuộc vào dòng điện để lưu trữ dữ liệu, thay vào đó sử dụng sự xoay của electron, cung cấp giải pháp hiệu quả hơn cho các chip dựa trên transistor.

“Là một nền tảng tính toán số cực kỳ tiết kiệm năng lượng, CRAM rất linh hoạt và có thể thực hiện tính toán ở bất kỳ vị trí nào trong mảng bộ nhớ. Vì vậy, chúng tôi có thể tái cấu trúc CRAM để đáp ứng tốt nhất nhu cầu hiệu suất của các thuật toán AI khác nhau,” Ulya Karpuzcu, giáo sư chuyên về kiến trúc tính toán và đồng tác giả của bài báo, cho biết.

Bản vẽ so sánh kiến trúc truyền thống của máy tính (a) với CRAM (b).

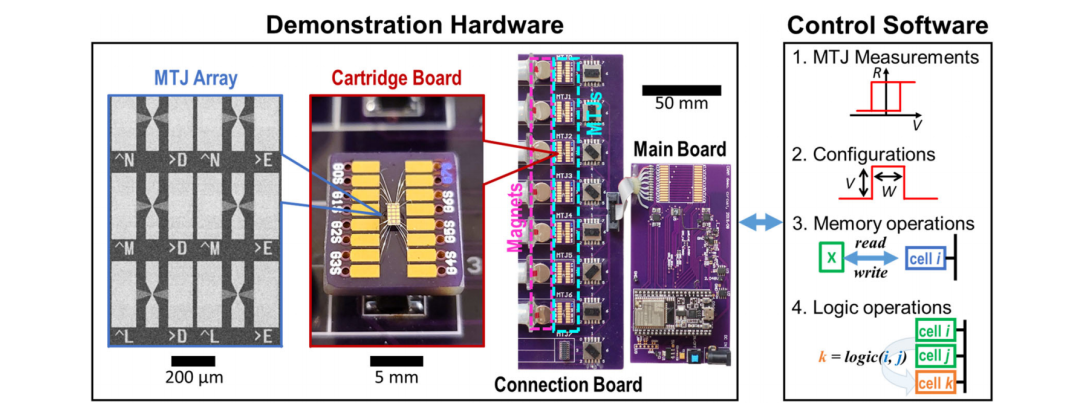

Thiết bị CRAM, gồm phần cứng tùy chỉnh và bộ phần mềm điều khiển.

CRAM vận hành theo cách số hóa hoàn toàn, trái ngược với hầu hết các giải pháp tính toán bộ nhớ khác, phần lớn hoặc toàn bộ là analog. CRAM cũng có các chức năng bổ sung như truy cập ngẫu nhiên dữ liệu và toán hạng, khả năng tính toán song song quy mô lớn và khả năng tái cấu trúc.

Các nhà nghiên cứu ước tính rằng máy học dựa trên CRAM có thể cải thiện hiệu suất năng lượng-trễ so với giải pháp hàng đầu hiện nay tới 1000 lần. Một ví dụ khác cho thấy CRAM (ở nút công nghệ 10 nm) thực hiện tác vụ phân loại chữ viết tay MNIST tiêu thụ 0,47 µJ và 434 ns năng lượng và thời gian, so với hệ thống xử lý gần bộ nhớ ở nút công nghệ 16 nm, nó giảm 2500 lần năng lượng và 1700 lần thời gian.

Thiết bị CRAM, gồm phần cứng tùy chỉnh và bộ phần mềm điều khiển.

CRAM là một bước tiến quan trọng trong việc tăng cường hiệu quả năng lượng cho trí tuệ nhân tạo trong thời đại mà nhu cầu năng lượng của AI đang gia tăng. Dự đoán của Cơ quan Năng lượng Quốc tế cho thấy mức tiêu thụ điện năng dành cho đào tạo và ứng dụng AI có thể tăng gấp đôi từ 460 terawatt giờ năm 2022 lên hơn 1000 terawatt giờ năm 2026, tương đương với lượng điện tiêu thụ của cả nước Nhật Bản.

Ngoài ra, các nghiên cứu cho thấy ChatGPT mỗi ngày phải xử lý khoảng 200 triệu yêu cầu, tiêu thụ hơn 500.000 kilowatt giờ điện, tương đương với lượng điện tiêu thụ của 17.000 hộ gia đình Mỹ. Dự đoán đến năm 2027, ngành công nghiệp AI sẽ tiêu thụ 85-134 terawatt giờ điện mỗi năm.

CRAM có khả năng giảm tiêu thụ năng lượng tới 1000 lần, rõ ràng giúp giải quyết vấn đề tiêu thụ năng lượng ngày càng gia tăng của AI.

Nghiên cứu này đã kéo dài hơn hai thập kỷ, “Ý tưởng ban đầu của chúng tôi về việc thực hiện tính toán trực tiếp trong bộ nhớ đã bị coi là điên rồ cách đây 20 năm,” Wang Jian-Ping, giáo sư xuất sắc và chủ tịch Robert F. Hartmann tại Khoa Kỹ thuật Điện và Máy tính của Đại học Minnesota, nói.

Trong những năm qua, nhóm nghiên cứu đã phát triển MRAM dựa trên nghiên cứu bằng sáng chế của MTJ. Thiết bị MTJ là một thiết bị nano được sử dụng để cải thiện ổ đĩa cứng, cảm biến và các hệ thống vi điện tử khác, bao gồm bộ nhớ ngẫu nhiên ngẫu nhiên dựa trên từ tính (MRAM).

Giáo sư Wang cho biết: “Kể từ năm 2003, cùng với sự phát triển của sinh viên và việc xây dựng một đội ngũ giảng viên liên ngành thực sự tại Đại học Minnesota, từ vật lý, kỹ thuật vật liệu, khoa học máy tính và kỹ thuật đến mô hình và thử nghiệm cũng như tạo ra phần cứng, chúng tôi đã đạt được kết quả tích cực và đã chứng minh rằng công nghệ này là khả thi và sẵn sàng được áp dụng.”

**Từ khóa:**

– Mô hình tính toán ngẫu nhiên trong bộ nhớ (CRAM)

– Trí tuệ nhân tạo

– Tiết kiệm năng lượng

– Kiến trúc Von Neumann

– Điện tử dựa trên spin

© Thông báo bản quyền

Bản quyền bài viết thuộc về tác giả, vui lòng không sao chép khi chưa được phép.

Những bài viết liên quan:

Không có đánh giá...