Stable Diffusion 3.0 cùng cấu trúc với Sora ra mắt mạnh mẽ! Tạo video 4 giây nhưng gặp sự cố, người dùng mạng: Vẫn nên chờ Sora!

Stability AI vừa công bố phiên bản Stable Diffusion 3.0, một mô hình tạo hình ảnh dựa trên AI đã gây ra sự xôn xao trong cộng đồng công nghệ. Đây là một công cụ chuyển đổi văn bản thành hình ảnh, được xem là công nghệ “hắc ám” mạnh mẽ nhất cho đến nay.

Với khả năng tạo ra các cảnh quan kỳ ảo đa chủ đề hoặc các bức chân dung phong cảnh có độ phân giải cao, Stable Diffusion 3.0 thực sự mở ra cánh cửa cho trí tưởng tượng của người dùng.

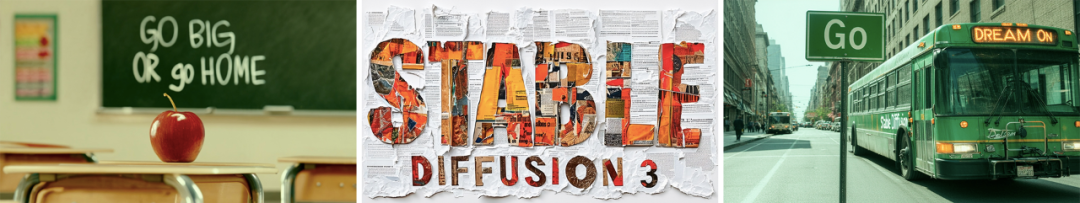

Nhóm phát triển Stability AI đã nhấn mạnh một số điểm nổi bật của phiên bản mới này, trong đó đáng chú ý nhất là khả năng xử lý văn bản. Họ đã cung cấp ba hình ảnh chứa văn bản trên trang web chính thức của họ, không chỉ rõ ràng mà còn hoàn toàn chính xác về chính tả.

CEO của Stability AI, Mostaque, cũng đã chia sẻ trên X (Twitter) về những hình ảnh chứa văn bản:

Cải tiến trong việc bố cục của Stable Diffusion 3.0 là kết quả của nhiều cải tiến mà nhóm đã xây dựng trong phiên bản mới này.

Mostaque cho biết: “Điều này đạt được nhờ vào kiến trúc Transformer và bộ mã hóa văn bản bổ sung. Hiện tại, chúng ta có thể tạo ra các câu hoàn chỉnh và phong cách nhất quán.”

Một điểm sáng khác là khả năng tạo ra nhiều chủ đề trong một hình ảnh từ một câu đơn giản, giúp người dùng có thể miêu tả hàng nghìn thế giới trong đầu họ bằng một câu nói.

Một yếu tố quan trọng khác là khả năng thay đổi một chủ đề mà không ảnh hưởng đến các yếu tố khác trong hình ảnh.

Một điểm đặc biệt khác là “chất lượng hình ảnh siêu cao”, đây thực sự là tin vui cho những người yêu thích chi tiết. Mỗi hình ảnh đều như một tác phẩm nghệ thuật. Ví dụ, bức ảnh cận cảnh về loài thằn lằn dưới đây:

Hình ảnh minh họa và phác thảo cũng đã được cải thiện đáng kể so với các phiên bản trước:

Tuy rằng Stable Diffusion 3.0 ban đầu được trình bày như một công nghệ chuyển đổi văn bản thành hình ảnh, nhưng nó sẽ trở thành nền tảng cho nhiều ứng dụng rộng rãi hơn. Trong những tháng gần đây, Stability AI cũng đã phát triển chức năng tạo hình ảnh 3D và video.

Mostaque cho biết: “Chúng tôi đang tạo ra các mô hình mở có thể sử dụng bất cứ lúc nào và phù hợp với mọi nhu cầu. Đây là một loạt mô hình đa kích thước, sẽ hỗ trợ sự phát triển của các mô hình thị giác thế hệ tiếp theo của chúng tôi, bao gồm cả video và 3D.”

Mostaque cũng đã chia sẻ một video về SD3D trên X (Twitter):

Thêm vào đó, Stable Video cũng đã chính thức mở cửa thử nghiệm công khai, hỗ trợ tạo video từ hình ảnh và từ văn bản. Mặc dù mọi người đang tập trung vào Sora, nhưng có ước tính rằng Sora sẽ cần ít nhất ba tháng nữa mới bắt đầu thử nghiệm nội bộ. Cần lưu ý rằng đây là thử nghiệm nội bộ, không giống như Stable Video, mà công khai thử nghiệm.

Dựa trên ví dụ từ trang web chính thức, các video được tạo ra có độ ổn định hình ảnh, độ di chuyển và mất chi tiết tương đương với Sora.

Một số người dùng đã thử nghiệm Stable Video đã nhận xét rằng mặc dù có sự khác biệt so với Sora, nhưng vẫn rất đáng mong đợi. Một người dùng đã chia sẻ: “Tôi đã thử nghiệm Stable Video với hình ảnh của mình và phát hiện rằng chỉ có hình ảnh không có khuôn mặt mới có kết quả tốt, còn hình có khuôn mặt thì không ổn.” Những người dùng khác bổ sung rằng với hình có khuôn mặt, giảm giá trị motion cũng có thể cho kết quả tương đối bình thường, nhưng sẽ bị giật.

Trong năm qua, Stability AI đã liên tục cải tiến và phát hành nhiều mô hình hình ảnh, mỗi mô hình đều thể hiện độ phức tạp và chất lượng ngày càng tăng. Phiên bản SDXL được công bố vào tháng 7 đã cải tiến đáng kể mô hình cơ bản của Stable Diffusion, và công ty hiện đang tìm kiếm sự phát triển tiếp theo.

Mô hình mới Stable Diffusion 3.0 nhằm mục đích cung cấp chất lượng hình ảnh cải thiện và hiệu suất tốt hơn để tạo ra hình ảnh từ nhiều chủ đề trong một câu nhắc. Nó cũng sẽ cung cấp bố cục tốt hơn so với các mô hình Stable Diffusion trước đây, dẫn đến việc tạo ra các hình ảnh có chính tả chính xác và nhất quán hơn. Trước đây, bố cục đã là một điểm yếu của Stable Diffusion, bao gồm cả DALL-E 3, Ideogram và Midjourney trong các phiên bản gần đây cũng đã nỗ lực giải quyết vấn đề này. Stability AI đang xây dựng các mô hình Stable Diffusion 3.0 với nhiều kích thước mô hình khác nhau, với phạm vi tham số từ 800M đến 8B.

Stable Diffusion 3.0 không chỉ là phiên bản mới của mô hình đã được công bố bởi Stability AI, mà thực tế dựa trên một kiến trúc hoàn toàn mới.

Emad Mostaque cho biết, Stable Diffusion 3 là phiên bản chính thống của Stable Diffusion gốc. Nó sử dụng kiến trúc Diffusion Transformer mới, tương tự như mô hình Sora được phát hành gần đây bởi OpenAI, đại diện cho đột phá công nghệ mới nhất trong lĩnh vực này.

Kỹ thuật “Diffusion Transformer” được đề xuất lần đầu tiên vào năm 2022 và được cải thiện vào năm 2023, hiện đã đạt được khả năng mở rộng. Ngoài ra, Stable Diffusion 3.0 còn sử dụng kỹ thuật “match flow”, cũng là một kỹ thuật cải thiện chất lượng mà không làm tăng gánh nặng thêm đáng kể.

Stability AI đã thử nghiệm nhiều phương pháp tạo hình ảnh khác nhau. Đầu tháng này, công ty đã công bố bản xem trước của Stable Cascade, sử dụng kiến trúc Würstchen để cải thiện hiệu suất và độ chính xác. Stable Diffusion 3.0 đã sử dụng một cách tiếp cận khác, sử dụng Diffusion Transformer.

Mostaque nhấn mạnh: “Stable Diffusion trước đây không có Transformer.”

Transformer là nền tảng của nhiều cuộc cách mạng AI, được sử dụng rộng rãi như một cơ sở cho các mô hình tạo văn bản. Tạo hình ảnh chủ yếu nằm trong lĩnh vực mô hình Diffusion. Bài nghiên cứu giải thích chi tiết về kiến trúc Diffusion Transformer (DiT) giải thích rằng đó là một cấu trúc mô hình Diffusion mới, thay thế bộ phận U-Net thông thường bằng một Transformer thao tác các khối hình ảnh tiềm ẩn. Phương pháp DiT có thể tận dụng hiệu quả hơn tài nguyên tính toán và có thể vượt trội hơn so với các dạng khác của tạo hình ảnh Diffusion.

Một cải tiến lớn khác của Stable Diffusion là kỹ thuật “match flow”. Bài nghiên cứu giải thích về kỹ thuật này cho biết đó là một phương pháp mới để đào tạo Continuous Normalizing Flows (CNFs) để mô phỏng phân phối dữ liệu phức tạp. Theo các nhà nghiên cứu, việc sử dụng Conditional Flow Matching (CFM) và optimal transport paths (đường vận chuyển tối ưu), so với diffusion paths, có thể đạt được huấn luyện nhanh hơn, lấy mẫu hiệu quả hơn và hiệu suất tốt hơn.

Từ khóa:

- Stable Diffusion 3.0

- AI

- Trí tuệ nhân tạo

- Mô hình tạo hình ảnh

- Diffusion Transformer

© Thông báo bản quyền

Bản quyền bài viết thuộc về tác giả, vui lòng không sao chép khi chưa được phép.

Những bài viết liên quan:

Không có đánh giá...